2024年2月28日(優分析產業數據中心) - 美光科技(MU-US)於本週一傳出,已開始大規模生產高頻寬記憶體(HBM)半導體,供Nvidia最新的人工智慧晶片使用。

美光表示,這款HBM3E(高頻寬記憶體3E)比競爭對手(意指南韓的SK海力士)的產品耗電量低30%,並且能夠滿足對於驅動生成式人工智慧應用的晶片需求飛速增長。

Nvidia將在其下一代H200 GPU中使用這款記憶體晶片,預計該晶片將在第二季度開始出貨,並將超越目前的H100晶片,H100晶片已經在過去帶動了Nvidia的收入大幅增長。

"我認為這對美光來說是一個巨大的機會,尤其是考慮到HBM晶片在人工智慧應用中的受歡迎程度似乎只會增加,"Moor Insights & Strategy的分析師Anshel Sag表示。

對HBM晶片的需求,目前是由Nvidia的供應商SK海力士所領軍,由於市場對人工智慧應用的需求強勁,抵消了美光在其它應用市場緩慢復甦的負面因素。

Sag補充說:"鑑於SK海力士已經幾乎完全賣出了其2024年的預計產量,市場上若有另一個供應來源,可以幫助像AMD、Intel或NVIDIA這樣的GPU製造商擴大他們的GPU生產。"

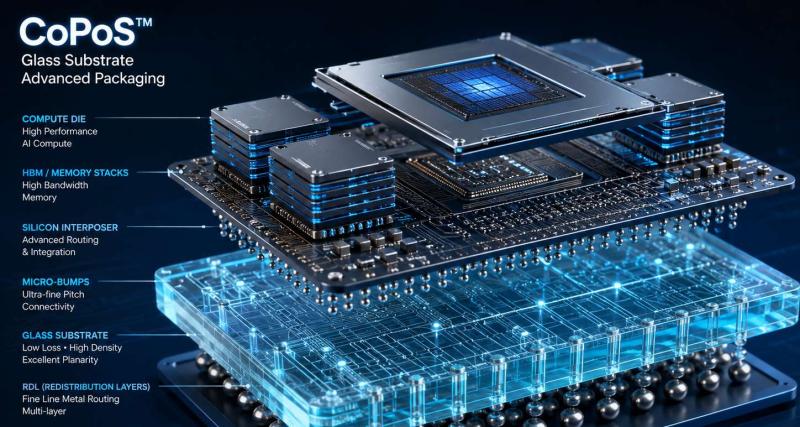

HBM是美光利潤率最高的產品之一,部分原因是其量產的技術複雜程度較高。

該公司此前表示,預計在2024財年的HBM收入將達到"數億美元",並在2025年持續增長。