輝達 (NVDA-US) 執行長黃仁勳今 (6) 日於 CES 2026 發布 NVIDIA Rubin 新平台,該平台包含 6 款全新晶片,目前已全面投產,產品將在 2026 年下半年問世,尤其 Rubin 平台每個詞元 (Token) 的成本較上一代 Blackwell 平台降低 10 倍,符合黃仁勳先前「買越多、省越多」的描述。

輝達此次推出的 Rubin 平台六款晶片,包含 NVIDIA Vera CPU、NVIDIA Rubin GPU、NVIDIA NVLink 6 交換器、NVIDIA ConnectX-9 SuperNIC、NVIDIA BlueField-4 DPU 與 NVIDIA Spectrum-6 乙太網路交換器,透過六款晶片協同合作,可大幅縮短訓練時間並降低推論詞元成本。

輝達創辦人暨執行長黃仁勳表示,Rubin 問世恰逢其時,因為 AI 運算對訓練與推論的需求正呈現爆炸性成長。憑藉輝達每年推出新一代 AI 超級電腦的節奏,以及 6 款全新晶片的極致協同設計,Rubin 正朝 AI 的下一個前沿邁出重大躍進。

Rubin 平台以美國天文學先驅 Vera Florence Cooper Rubin 命名,其發現改變了人類對宇宙的理解。Rubin 平台包括 NVIDIA Vera Rubin NVL72 機架級解決方案與 NVIDIA HGX Rubin NVL8 系統。

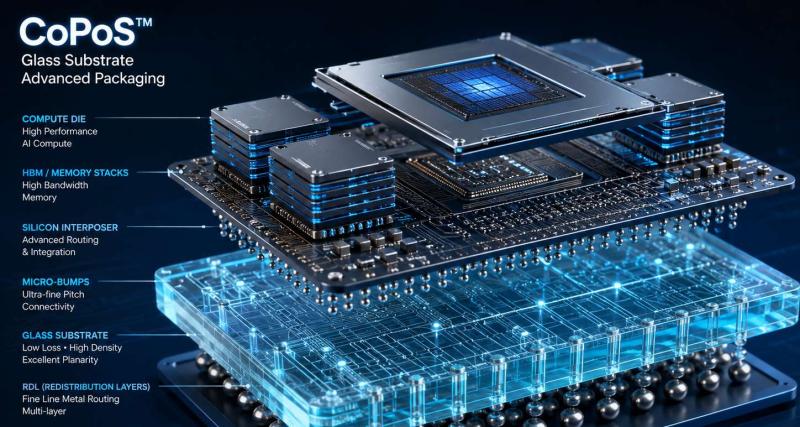

Rubin 平台導入五項創新技術,包括最新一代的 NVIDIA NVLink 互連技術、Transformer Engine、機密運算與 RAS Engine,以及 NVIDIA Vera CPU。這些突破將加速代理型 AI、先進推理與大規模混合專家 (MoE) 模型推論,而每個詞元的成本相較 NVIDIA Blackwell 平台降低高達 10 倍。與前代產品相比,更使用減少 4 倍的 GPU 數量即可訓練混合專家模型,以加速 AI 應用。

輝達表示,代理型 AI 與推理模型以及尖端影片生成工作負載,正在重新定義運算的極限。多步驟問題解決要求模型能夠處理、推理並針對長序列的詞元間進行操作。為滿足複雜 AI 工作負載需求而設計的 Rubin 平台,具備五項突破性技術。

第六代 NVIDIA NVLink 提供當今大規模混合專家模型所需快速且無縫的 GPU 對 GPU 通訊。 每顆 GPU 可提供每秒 3.6TB 的頻寬,而 Vera Rubin NVL72 機架可提供每秒 260TB 的頻寬,超越整個網際網路的總頻寬。NVIDIA NVLink 6 交換器內建的網路內運算功能以加速集體運作,並具備強化的可維護性與韌性,可大規模實現更快速、更高效的 AI 訓練與推論。

NVIDIA Vera CPU 專為代理型推理而設計,是大型 AI 工廠最為節能的 CPU。 此 NVIDIA CPU 搭載 88 個 NVIDIA 客製化的 Olympus 核心,完全相容於 Armv9.2,並提供超快速的 NVLink-C2C 連線能力。 Vera 提供卓越的效能、頻寬與業界領先的效率,可支援全方位的現代資料中心工作負載。

NVIDIA Rubin GPU 採用第三代 Transformer 引擎與硬體加速自適應壓縮技術,可為 AI 推論提供 50 petaflops 的 NVFP4 運算能力。

第三代 NVIDIA 機密運算:Vera Rubin NVL72 是首款支援 NVIDIA 機密運算的機架級平台,能夠在 CPU、GPU 與 NVLink 網域間維護資料安全,為全球最大型的專有模型、訓練與推論工作負載提供防護。

第二代 RAS 引擎:Rubin 平台橫跨 GPU、CPU 與 NVLink,具備即時健康檢測、容錯機制與主動維護功能,可將系統生產力發揮到極致。機架採用模組化無纜線托盤設計,組裝與維修效率較 Blackwell 提升高達 18 倍。

AI 原生儲存與安全的軟體定義基礎設施 NVIDIA Rubin 推出 NVIDIA 推論情境記憶儲存平台 (NVIDIA Inference Context Memory Storage Platform),這款新一代 AI 原生儲存基礎設施,以千兆級規模擴展推論情境。

該平台採用 NVIDIA BlueField-4,可在 AI 基礎設施之間高效共享與重複使用鍵值快取資料,提升回應能力與輸送量,同時實現代理型 AI 可預測且節能的擴充。

隨著 AI 工廠愈加採用裸機與多租戶部署模型,保持強大的基礎設施控制與隔離變得至關重要。BlueField-4 引進先進安全可信任資源架構 (Advanced Secure Trusted Resource Architecture,ASTRA),這是一種系統級信任架構,可為 AI 基礎設施建構商提供單一且受信任的控制點,在不影響效能的情況下,安全地佈建、隔離及營運大規模 AI 環境。

隨著 AI 應用向多回合代理推理演進,AI 原生組織必須跨使用者、工作階段與服務,管理及分享大量推論情境,適用於不同工作負載的不同配置形式。NVIDIA Vera Rubin NVL72 提供整合了 72 個 NVIDIA Rubin GPU、36 個 NVIDIA Vera CPU、NVIDIA NVLink 6、NVIDIA ConnectX-9 SuperNIC 與 NVIDIA BlueField-4 DPU 的安全統一系統。

NVIDIA 也將提供 NVIDIA HGX Rubin NVL8 平台,這款伺服器主機板可透過 NVLink 連接八個 Rubin GPU,以支援 x86 架構的生成式 AI 平台。HGX Rubin NVL8 平台可加速 AI 與高效能運算工作負載的訓練、推論與科學運算。

NVIDIA DGX SuperPOD 可作為大規模部署 Rubin 系統的參考,將 NVIDIA DGX Vera Rubin NVL72 或 DGX Rubin NVL8 系統與 NVIDIA BlueField-4 DPU、NVIDIA ConnectX-9 SuperNIC、NVIDIA InfiniBand 網路與 NVIDIA Mission Control™ 軟體整合。

先進的乙太網路與儲存是 AI 基礎設施的元件,對於維持資料中心全速運作、提升效能與效率,以及降低成本至關重要。NVIDIA Spectrum-6 乙太網路是新一代的 AI 網路乙太網路,以更高的效率與更強的韌性擴展 Rubin AI 工廠,並由 200G SerDes 通訊電路、共同封裝光學元件與 AI 最佳化網狀架構支援。

Spectrum-X 乙太網路光子學共同封裝光學交換器系統以 Spectrum-6 架構為基礎,相較於傳統方法,可為 AI 應用提供 10 倍的可靠性,並將上線時間延長 5 倍,同時將能源效率提升 5 倍,將每瓦效能提升至最高。Spectrum-XGS 乙太網路技術為 Spectrum-X 乙太網路平台的一部分,可讓相隔數百公里或以上的設施作為單一 AI 環境運作。

這些創新技術共同定義了新一代 NVIDIA Spectrum-X 乙太網路平台,採用 Rubin 的極致協同設計,可支援大規模 AI 工廠,為未來百萬台 GPU 環境奠定基礎。

※ 本文經「鉅亨網」授權轉載,原文出處